티스토리 뷰

Udate 2021.08.24.

내가말한게 이거였음

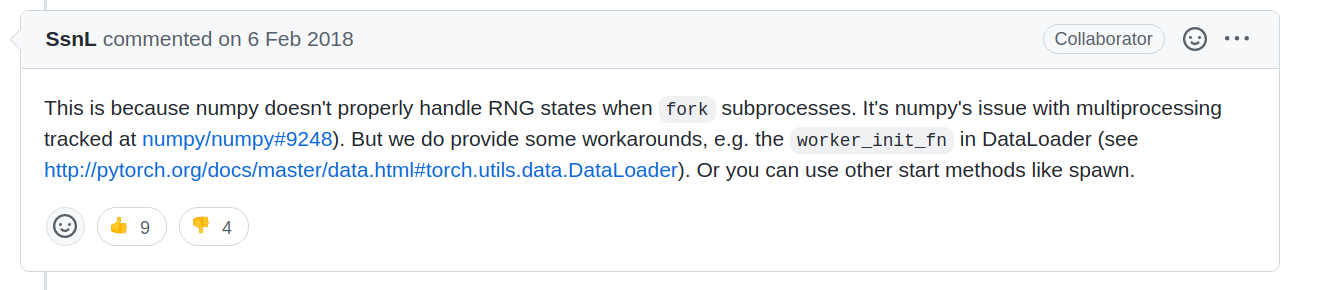

https://github.com/pytorch/pytorch/issues/5059#issuecomment-404232359

np.random generates the same random numbers for each data batch · Issue #5059 · pytorch/pytorch

For example, the following script from __future__ import print_function import numpy as np import random # np.random.seed(0) class Transform(object): def __init__(self): pass def __call__(self, ite...

github.com

Reproducible PyTorch를 위한 randomness 올바르게 제어하기!

PyTorch 코드의 완벽한 재현을 위해 고려해야할 randomness를 제어하는 법을 설명드리겠습니다.

hoya012.github.io

아 근데 옛날에 실험할 때 numpy random seed를 고정해놓으면 thread마다 항상 같은 값을 내도록 됭어있어서 성능에 악영향이 있었던 것 같은데 확인해봐야겠다. 의도한 것은 thread마다도 다른 값을 내야됨. 정확히 문제가 뭐였는 지 기억이 안남. 그때 블로그에 적어둘걸..

괜찮은듯?

'Research (연구 관련)' 카테고리의 다른 글

| scatter min (0) | 2021.08.24 |

|---|---|

| remote tensorboard (0) | 2021.08.14 |

| DP vs DDP (0) | 2021.08.13 |

| osmesa, pyrender, torch training bug (0) | 2021.08.13 |

| ray & 3d bounding box intersection (0) | 2021.08.09 |

공지사항

최근에 올라온 글

최근에 달린 댓글

- Total

- Today

- Yesterday

링크

TAG

- Generative model

- VAE

- Virtual Camera

- Machine Learning

- focal length

- Interview

- 피트니스

- demo

- 문경식

- camera coordinate

- 2d pose

- world coordinate

- nohup

- deep learning

- pytorch

- 헬스

- pyrender

- part segmentation

- Docker

- 머신러닝

- spin

- 컴퓨터비젼

- 에디톨로지

- 컴퓨터비전

- Pose2Mesh

- Transformation

- densepose

- 비전

- nerf

- 인터뷰

| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | 6 | 7 |

| 8 | 9 | 10 | 11 | 12 | 13 | 14 |

| 15 | 16 | 17 | 18 | 19 | 20 | 21 |

| 22 | 23 | 24 | 25 | 26 | 27 | 28 |

글 보관함