pytorch batch normalization

pytorch batch normalization

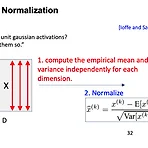

모듈화된 모델을 사용하고 있는데, 하나의 모듈을 pretrain 시킨 후 전체 모델에 통합시킨 후 다시 학습시켰을 때 성능이 떨어지는 현상이 있었다. Formulation이 아래와 같을 때 Formulation: input -> middle output -> final output input->middle output을 pretrain했다는 것이고, 이 때 middle output의 error가 50이었는데, 전체 모델에 통합시킨 후 다시 학습시켰을 때 middle output의 error가 55로 안 좋아졌다는 말이다. 원인은 2가지가 있는데, 1. pretrain했을 때의 learning rate와 전체 모델에 통합시킨 후에 학습시킬 때의 learning rate가 다르다는 점, 2. pytorch ..

Research (연구 관련)

2020. 2. 5. 15:24

공지사항

최근에 올라온 글

최근에 달린 댓글

- Total

- Today

- Yesterday

링크

TAG

- nohup

- Virtual Camera

- 헬스

- 비전

- pyrender

- focal length

- camera coordinate

- deep learning

- 에디톨로지

- nerf

- Transformation

- Interview

- world coordinate

- 컴퓨터비전

- 인터뷰

- demo

- 문경식

- Generative model

- densepose

- 2d pose

- Machine Learning

- 머신러닝

- 컴퓨터비젼

- Docker

- 피트니스

- part segmentation

- VAE

- spin

- Pose2Mesh

- pytorch

| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | ||

| 6 | 7 | 8 | 9 | 10 | 11 | 12 |

| 13 | 14 | 15 | 16 | 17 | 18 | 19 |

| 20 | 21 | 22 | 23 | 24 | 25 | 26 |

| 27 | 28 | 29 | 30 |

글 보관함